Qué es Ollama exactamente

Ollama es una herramienta diseñada para ejecutar modelos de lenguaje de forma local y ponerlos a trabajar desde terminal, API o integraciones con otras aplicaciones. Su documentación oficial lo presenta como una manera rápida de empezar a usar modelos como Gemma 3, DeepSeek-R1 o Qwen3, tanto en macOS, como en Windows y Linux.

Pero más allá de la definición técnica, lo realmente interesante de Ollama es lo que representa.

Vivimos en una época en la que casi todo pasa por la nube: modelos, datos, procesamiento, automatizaciones… Todo está cada vez más externalizado. Y aunque eso tiene ventajas evidentes en comodidad y escalabilidad, también implica una cesión de control. Ahí es donde Ollama marca una diferencia importante.

Desde mi punto de vista, su valor no está solo en que puedas ejecutar un modelo en local, sino en que recuperas algo que parecía haberse perdido en el ecosistema de la IA: el control sobre la herramienta y sobre el entorno donde corre.

Con Ollama, el uso local permite que tus prompts y datos no tengan por qué salir de tu máquina, y la propia documentación aclara que, cuando se ejecuta localmente, Ollama no envía tus prompts ni tus respuestas a ollama.

Cómo funciona Ollama en local

El funcionamiento de Ollama es bastante directo:

- Instalas Ollama en tu sistema.

- Descargas o ejecutas un modelo compatible.

- Interactúas con él desde terminal o mediante su API local.

- Lo integras en tus propias herramientas, scripts o aplicaciones si lo necesitas.

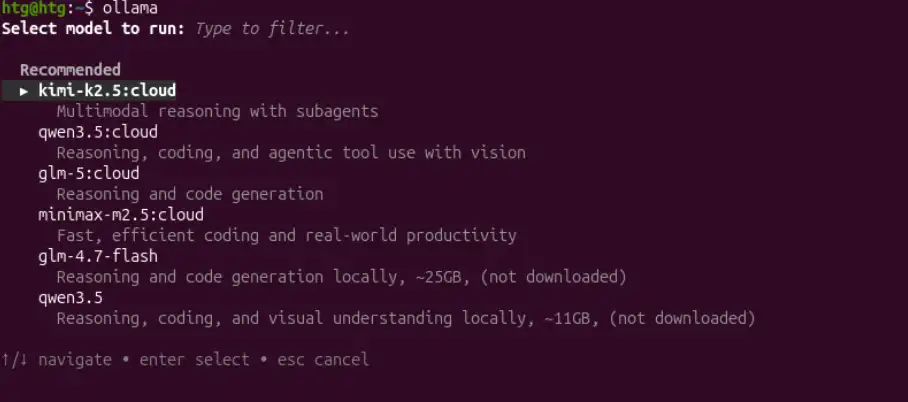

La guía rápida oficial indica que puedes iniciar el menú interactivo simplemente ejecutando:

ollamaY también puedes lanzar directamente un modelo con un comando como:

ollama run gemma3Además, Ollama expone una API local en localhost:11434, lo que facilita integrarlo con desarrollos propios, automatizaciones o herramientas internas.

Qué hace diferente a Ollama frente a usar IA en la nube

La gran diferencia está en la arquitectura.

Cuando usas una herramienta cloud, dependes de:

- una API externa,

- los límites del proveedor,

- la latencia,

- y, en muchos casos, de cómo se gestionan tus datos.

Con Ollama, en cambio, trabajas en un entorno mucho más controlado. Y eso cambia bastante la perspectiva.

Para mí, el gran atractivo de Ollama no es solo ejecutar modelos localmente, sino dejar de depender tanto de terceros para poder usar IA de forma seria. En ciertos contextos, eso no es un detalle: es una diferencia estratégica.

Para qué sirve Ollama en la práctica

Hablar de Ollama solo como “una herramienta para correr modelos” se queda corto. En la práctica, sirve para bastante más.

1. Usar IA sin depender de una API externa

Uno de sus usos más claros es montar un entorno en el que puedas trabajar con modelos sin estar atado constantemente a un proveedor cloud. Eso encaja muy bien en:

- pruebas internas,

- automatizaciones,

- asistentes privados,

- entornos de desarrollo,

- flujos experimentales con IA.

2. Proteger mejor la privacidad de los datos

Cuando trabajas con documentación interna, procesos confidenciales o información sensible, enviar todo a servicios externos puede ser una limitación. La ejecución local de Ollama reduce esa fricción y permite construir un flujo mucho más controlado.

Y aquí es donde yo lo veo especialmente útil: cuando los datos importan de verdad, no depender de la nube deja de ser una comodidad y pasa a convertirse en una ventaja competitiva.

3. Crear asistentes, herramientas y automatizaciones propias

Ollama no se queda en el chat básico. Su documentación incluye API, CLI e integraciones con herramientas externas, lo que lo convierte en una base muy interesante para montar soluciones personalizadas.

4. Probar modelos open source en tu propio entorno

También es una opción muy atractiva para perfiles técnicos, desarrolladores y empresas que quieren experimentar con modelos abiertos sin desplegar una infraestructura compleja desde cero. La propia documentación oficial muestra modelos destacados y opciones para importar modelos personalizados mediante Modelfile.

Ventajas de usar Ollama

Privacidad y control

La principal ventaja es evidente: más control sobre tus datos y sobre dónde ocurre la inferencia.

Menos dependencia de terceros

No estás sujeto del mismo modo a límites de uso, cambios de precios o disponibilidad de una API externa.

Flexibilidad técnica

Ollama ofrece:

- CLI

- API local

- integraciones

- posibilidad de trabajar con distintos modelos abiertos.

Buen punto de partida para empresas

Para equipos que manejan información interna o quieren montar una capa de IA privada, Ollama encaja muy bien como base inicial.

Desventajas y limitaciones de Ollama

Aquí conviene ser realistas.

No es magia

Ollama simplifica mucho el acceso a modelos locales, pero los recursos del servidor o del equipo siguen importando. Si quieres trabajar con modelos más pesados o contextos más amplios, el hardware manda. La propia documentación incluye apartados específicos sobre soporte GPU y aceleración por hardware.

Puede ser más técnico que una solución cloud

Aunque el quickstart es sencillo, la experiencia sigue siendo más técnica que abrir una herramienta SaaS y empezar a escribir.

No siempre compensa

Si solo buscas la opción más simple posible y no te preocupa privacidad, dependencia de APIs ni control del entorno, probablemente una solución cloud siga siendo más cómoda.

Ollama en un servidor VPS: una opción muy interesante

Uno de los enfoques más interesantes de Ollama es que no tienes por qué limitarlo a tu ordenador personal. También puedes montarlo en un servidor VPS y usarlo como base para asistentes privados, automatizaciones internas o entornos de pruebas accesibles 24/7.

Esto tiene bastante sentido cuando:

- quieres un entorno siempre encendido,

- prefieres separar la carga de tu equipo local,

- necesitas acceso remoto,

- o quieres construir una solución más estable para uso profesional.

En este punto, un VPS con acceso root encaja especialmente bien, porque te permite instalar dependencias, configurar servicios y controlar el entorno completo. En HostingTG disponéis de servidores VPS con acceso root, discos NVMe y distintos planes escalables, lo que puede ser una buena base para desplegar Ollama en un entorno más serio que un PC doméstico.

Cómo instalar Ollama por primera vez en un VPS

Requisitos básicos recomendados

Antes de empezar, yo dejaría claro que necesitas al menos:

- un VPS Linux limpio,

- acceso root por SSH,

- conexión a internet,

- y recursos suficientes según el modelo que quieras ejecutar.

En el ecosistema de HostingTG, el acceso root y el enfoque autogestionado.

Paso 1: conectarte al VPS por SSH

Lo primero es entrar al servidor:

ssh root@IP_DE_TU_VPSUna vez dentro, conviene actualizar paquetes antes de instalar nada:

apt update && apt upgrade -yEste paso no es exclusivo de Ollama, pero sí una práctica recomendable para partir de un entorno limpio y estable.

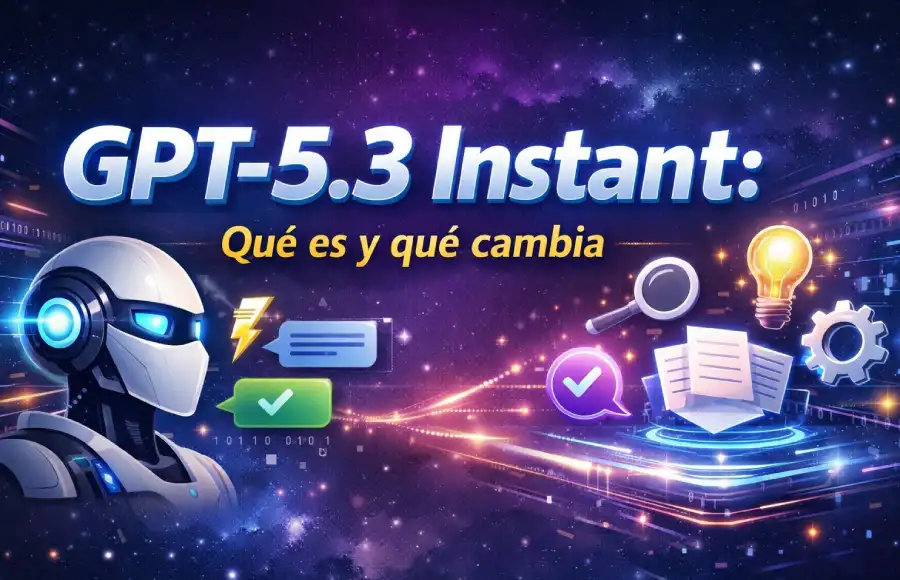

Paso 2: instalar Ollama en Linux

La documentación oficial de Ollama para Linux indica este comando de instalación:

curl -fsSL https://ollama.com/install.sh | shEse es el método oficial recomendado para instalar Ollama en Linux.

Paso 3: comprobar que Ollama está instalado

Después de la instalación, puedes verificar que responde correctamente con:

ollamaLa guía rápida oficial indica que ese comando abre el menú interactivo de Ollama.

Paso 4: ejecutar tu primer modelo

Para una primera prueba, puedes lanzar un modelo con un comando como este:

ollama run gemma3Ese ejemplo aparece en la referencia CLI oficial.

A partir de ahí, Ollama descargará el modelo y lo dejará listo para interactuar desde terminal.

Paso 5: probar la API local

Si quieres demostrar que la instalación funciona a nivel de integración, puedes hacer una petición a la API local con este ejemplo oficial:

curl http://localhost:11434/api/chat -d '{

"model": "gemma3",

"messages": [{ "role": "user", "content": "Hola" }]

}'La documentación de quickstart muestra precisamente ese enfoque para empezar a usar la API.

Paso 6: pensar en acceso externo y seguridad

Aquí yo añadiría una advertencia importante de optimización y credibilidad:

instalar Ollama en un VPS no significa exponerlo a internet sin más.

Si vas a usarlo fuera del propio servidor, conviene revisar:

- firewall,

- puertos,

- proxy inverso,

- autenticación,

- y acceso restringido por IP o VPN.

Ese detalle no solo mejora el artículo a nivel práctico, también transmite experiencia real y evita que el contenido se quede en un tutorial superficial.

¿Merece la pena montar Ollama en un VPS?

En mi opinión, sí, en muchos casos.

Montarlo en un VPS tiene sentido cuando buscas:

- disponibilidad 24/7,

- más estabilidad,

- acceso remoto,

- y un entorno separado de tu ordenador personal.

Además, te permite empezar en pequeño e ir escalando recursos si el proyecto crece. Y si ya trabajas con un proveedor que ofrece VPS con acceso root, como es el caso de HostingTG, la puesta en marcha resulta bastante natural para un proyecto técnico o empresarial.

Eso sí: igual que pasa en local, el rendimiento dependerá del hardware disponible y del modelo que quieras mover. Si el objetivo es usar modelos ligeros o hacer pruebas controladas, un VPS puede ser una muy buena puerta de entrada. Si quieres modelos más grandes o cargas intensivas, ya toca dimensionar mejor la infraestructura.

Sobre Ollama

Ollama se ha convertido en una de las herramientas más interesantes para quienes quieren usar IA en local con más autonomía, más privacidad y menos dependencia de terceros. No porque sustituya automáticamente a toda la nube, sino porque ofrece una alternativa muy sensata cuando el control del entorno importa de verdad.

Y si además quieres llevar ese enfoque un paso más allá, montar Ollama en un VPS puede ser una muy buena decisión. Te permite disponer de un entorno siempre activo, más estable y más profesional, especialmente si cuentas con un servidor VPS con acceso root sobre el que puedas instalar y configurar todo a tu medida.

Dudas de la comunidad

¿Ollama funciona sin internet?

Sí. La ejecución local permite usar modelos sin depender de una API remota, y la FAQ oficial indica que Ollama no envía tus prompts ni respuestas a ollama.com cuando corre localmente.

¿Se puede instalar Ollama en Linux?

Sí. La documentación oficial para Linux indica un instalador directo mediante script.

¿Puedo montar Ollama en un VPS?

Sí. Siempre que dispongas de un VPS Linux con acceso root y recursos suficientes, puedes instalarlo y usarlo como entorno de inferencia o integración.

¿Ollama sirve para empresas?

Puede encajar muy bien en empresas que necesitan más control, privacidad o pruebas internas con IA, especialmente en entornos sensibles.

Opinión Personal

Personalmente, creo que Ollama representa uno de los movimientos más interesantes dentro del mundo de la inteligencia artificial actual. En un momento en el que casi todo depende de la nube, las APIs externas y servicios de terceros, poder ejecutar modelos en tu propio entorno me parece una propuesta con muchísimo valor.

Lo que más me convence de Ollama es que devuelve al usuario parte del control que parecía perdido. No hablo solo de comodidad técnica, sino de algo más importante: privacidad, autonomía y libertad para experimentar. Poder trabajar con modelos de IA sin que los datos salgan de tu entorno, sin depender de límites impuestos por una plataforma externa y con mayor capacidad de personalización es, para mí, una ventaja muy potente.

Ahora bien, también creo que conviene mantener una visión realista. Ollama no es una solución mágica para todo el mundo. Si no cuentas con un equipo o un servidor con suficientes recursos, la experiencia puede quedarse corta. Además, para usuarios menos técnicos, sigue siendo una opción algo más exigente que una herramienta en la nube lista para usar desde el primer minuto.

Aun así, incluso con esas limitaciones, mi sensación es clara: la IA local va a seguir ganando protagonismo, y Ollama está muy bien posicionado para formar parte de ese cambio. Sobre todo en empresas, desarrolladores y proyectos donde la privacidad, el control y la independencia tecnológica son factores clave.

En definitiva, Ollama me parece una herramienta con mucho presente y todavía más futuro. No porque vaya a sustituir por completo a la nube, sino porque ofrece una alternativa muy sólida para quienes buscan una forma más autónoma, privada y flexible de trabajar con inteligencia artificial.

¿Y tú qué opinas sobre Ollama? Te leo en los comentarios: cuéntame si ya lo has probado, si lo instalarías en local o en un VPS, o qué ventajas y limitaciones le ves.