Qué es Gemini 3 y en qué mejora a 2.5

Gemini 3 no es “una versión más”; es el giro en el que Google pasa de “estar en la carrera” a decir alto y claro: quiero ir en cabeza. Yo lo noto en el planteamiento: ya no llega como demo brillante que enseñas en una conferencia y luego aparcas; llega como capa transversal que se superpone a casi todo lo que toca Google. En la práctica, esto significa dos cosas muy concretas: (1) más potencia de razonamiento y planificación sostenida en tareas largas (documentos extensos, proyectos con múltiples pasos, seguimiento en el tiempo) y (2) multimodalidad de verdad que combina texto, código, tablas, imágenes y hasta clips de vídeo sin obligarte a trocear el problema.

Frente a Gemini 2.5, el salto que más se nota no es un número de benchmark aislado, sino la sensación de continuidad: empiezo un trabajo en el móvil con la app de Gemini, lo continúo en el navegador y lo escalo a un flujo más serio en Vertex AI sin perder el “hilo” del agente.

Y aquí entra uno de los puntos más ambiciosos: la ventana de contexto grande (útil para “recordar” lo que ya pasó) combinada con técnicas de razonamiento tipo chain of thought y planificación, que permiten que el sistema no se quede solo en respuestas puntuales, sino en planes. Cuando trabajas con piezas largas (briefings, repositorios, actas de reuniones, investigación con PDFs) el cambio es tangible: menos “copia y pega” y más “vamos a resolverlo por fases”.

El otro avance donde se siente músculo es la consistencia. Ya no hablamos solo de clavar una respuesta brillante una vez; hablamos de sostener precisión en iteraciones. En mi caso, esa estabilidad hace que me atreva a delegar tareas más largas: “repásame este guion, compáralo con el documento de requisitos, sugiere cambios y prepara un plan de pruebas”. Antes me frenaba el miedo a que la IA “se olvidara” del contexto; ahora, la barrera psicológica baja y empiezo a tratarlo como un compañero que aguanta la conversación.

Benchmarks clave en 1 minuto (explicados para humanos)

- Razonamiento y planificación: menos atajos, más pasos intermedios visibles y defensables.

- Código y tareas técnicas: mejora en resolución de issues reales (no solo puzzles sintéticos).

- Multimodalidad: combinar texto+imagen+estructura de datos y que la respuesta use todo a la vez.

El resumen: Gemini 3 no huele a laboratorio; huele a producto para medio planeta. Ese es el salto que redefine expectativas.

Gemini 3 en la Búsqueda (AI Mode): del enlace a la interpretación

Que la Búsqueda integre Gemini 3 “desde el minuto uno” cambia el contrato social del buscador. Antes, escribías una consulta y recibías enlaces. Ahora, cada vez más, recibes interpretaciones: un resumen, un plan, pasos sugeridos, comparativas directas. Como usuario, esto es comodísimo; como creador y como ciudadano, impone una nueva pregunta: ¿quién decide qué se prioriza, qué se oculta y cómo se encuadra la información?

En el día a día, AI Mode me ha ahorrado tiempo en consultas largas: “compárame regulaciones X e Y, resume requisitos para pymes y crea una checklist”. También en búsquedas locales complejas: “encuéntrame academias que cumplan A+B+C y dame pros/cons”. Pero, como tú mismo apuntabas, cada vez dependemos más de ese filtro inteligente. Yo lo gestiono así:

- Consulta en dos capas: primero dejo que AI Mode haga el resumen; después abro 3–4 fuentes para contrastar.

- Prompt de transparencia: pido que liste fuentes y explique criterios de priorización (“¿por qué estas y no otras?”).

- Lista de verificación: cuando la respuesta tiene impacto (presupuesto, legal, salud), obligo al sistema a darme contraejemplos y riesgos conocidos.

No se trata de “sí o no” a AI Mode, sino de aprender a co-conducir con la IA. El buscador ya no devuelve enlaces: cada vez más, devuelve interpretaciones. Ganamos velocidad, pero debemos vigilar el sesgo de presentación.

Cómo pedir calidad en AI Mode

- “Dame fuentes con diversidad (académicas, prensa, blog técnico) y justifica cada una en una línea.”

- “Construye dos marcos opuestos y dime en qué escenario gana cada uno.”

- “Genera pasos accionables y un plan de comprobación para validar que lo aplicado funciona.”

Programación y agentes: así es Google Antigravity

Antigravity es el mensaje más claro: Google no quiere que solo hagas preguntas; quiere que construyas ahí dentro. Es un entorno pensado para que agentes y desarrolladores trabajen en continuo con editor, terminal, navegador y pruebas, sin estar saltando de pestaña en pestaña. En mi experiencia, la sensación es que “Antigravity no te ayuda a programar; programa contigo”. ¿Qué quiere decir esto en concreto?

- Tareas persistentes: abres un issue, el agente propone enfoque, crea ramas, escribe tests, ejecuta, recoge logs y ajusta el PR.

- Contexto vivo: el “estado” del proyecto no se pierde entre mensajes; la IA entiende dependencias y decide cuándo leer documentación, cuándo abrir el REPL o cuándo lanzar un test end-to-end.

- Diseño-a-código: pasas un esquema (texto o imagen) y el agente levanta un scaffold con componentes, estilos y tests de humo.

¿Sustituye a un developer? No. Sube el listón de lo que un solo developer puede abarcar en una tarde. Donde antes invertías dos horas en “papeleos de infraestructura”, ahora las dedicas a negociar criterios de calidad con el agente. Y sí, sigue habiendo fricción (cuando el agente se obceca en un enfoque), pero la dirección es inequívoca: menos contexto muerto, más flujo.

Antigravity vs copilotos clásicos

- Copiloto: te sugiere líneas o funciones; útil, pero atomizado.

- Antigravity: idea → diseño → código → prueba → despliegue, con memoria y objetivos.

Resultado: si tu equipo adopta esto bien, recortas ciclos de validación y elevas consistencia entre servicios.

Ventana de 1M tokens y multimodalidad: casos que sí notarás

La cifra por sí sola impresiona, pero lo importante es qué desbloquea. Con una ventana amplia, puedo:

- Revisar proyectos completos: pasar un repositorio mediano y pedir “mapa de dependencias, deuda técnica y quick wins de refactor”. La IA no tiene que mirar el repo “a través de una mirilla”; ve el mural completo.

- Analizar documentos largos: contratos, pliegos técnicos, manuales. Pido un resumen jurídico con apartados críticos, riesgos, cláusulas a negociar y plantillas de email para cada punto.

- Multimedia con propósito: combino un informe con capturas y un vídeo corto de un bug; la IA entiende el contexto cruzado y sugiere causas probables.

Aquí es donde se desata la planificación a largo plazo. En mi caso, lo noto cuando encargo “prepara un plan de 6 semanas para lanzar X: backlog, dependencias, hitos, señales de éxito y alertas tempranas”. Antes obtenía listas genéricas; ahora aparecen esquemas con memoria de lo que ya dijimos y lo que falta por validar.

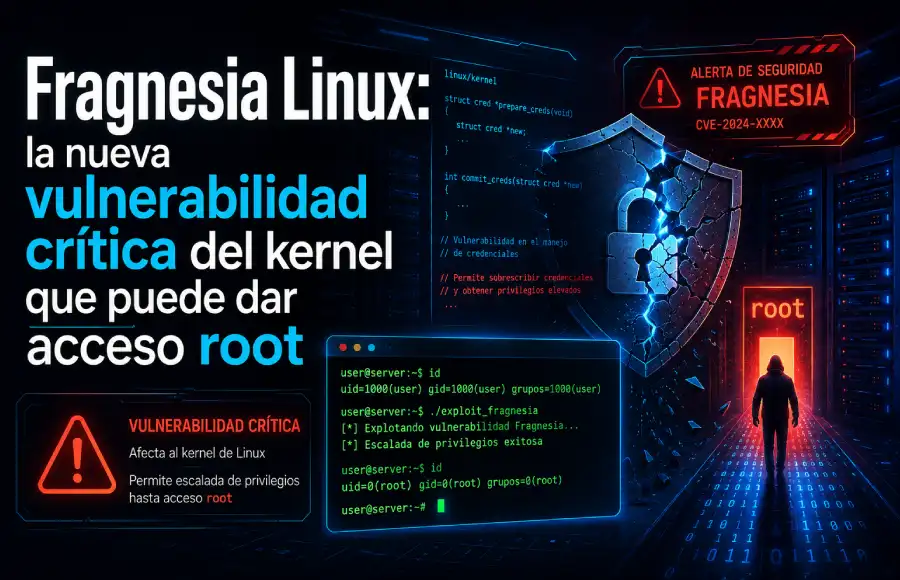

Disponibilidad, idiomas y planes: dónde y cómo usarlo

La oferta se presenta clara para tres perfiles:

- Usuario final: app de Gemini y modo integrado en Búsqueda (AI Mode), con soporte multilingüe amplio.

- Creador y profesional: AI Studio para prototipar rápidamente flujos, conectar datos y probar prompts con guardrails.

- Empresa: Vertex AI para llevar esos prototipos a producción (roles, auditoría, trazabilidad, control de costes) y Antigravity para acelerar equipos técnicos.

Si estás en España o LatAm, el despliegue de funciones suele llegar de forma escalonada; mi recomendación es activar notificaciones en la app, probar AI Mode cuando aparezca y replicar algunos flujos críticos en AI Studio para tener un “plan B” cuando una funcionalidad aún no esté en tu región. El objetivo es que no te frenes por el calendario: prototipa con lo que tengas hoy y migra en cuanto se habilite oficialmente.

Impacto en negocio y marketing: oportunidades y riesgos

Tu impresión encaja con lo que veo: hemos entrado en modo sprint permanente. Para negocio y marketing, esto trae tres oportunidades inmediatas:

- Producción con control: generar borradores, anuncios, variaciones y pruebas A/B con una consistencia de marca mucho mayor, porque el sistema retiene guías de estilo y aprende de feedback.

- Investigación acelerada: analizar categorías, precios y mensajes de la competencia con informes repetibles que no dependen de “una inspiración puntual”.

- Operaciones: playbooks ejecutables donde el agente no solo “explica qué hacer”, sino que lo hace (compila fuentes, llena plantillas, prepara datasets).

¿Riesgos? Dos:

- Dependencia de una plataforma: cuanto más concentramos trabajo en una, más frágiles somos ante cambios de política o precio. Mitigación: portabilidad de prompts y datos, y un “gemelo” de tus flows críticos en otra herramienta.

- Opacidad del filtro en Búsqueda/AI Mode: si te juegas tráfico orgánico, monitoriza tus SERPs con y sin AI Mode, evalúa cómo aparece tu marca en respuestas generativas y ajusta esquemas/Entity SEO para ser elegible en resúmenes.

Comparativa práctica: Gemini 3 vs alternativas en tareas reales

Me gusta bajarlo a tierra con tareas:

- Briefings complejos (varias fuentes): Gemini 3 brilla en mantener el hilo y sugerir planes de lectura; donde otras IAs responden bien una vez pero “se cansan” en la cuarta iteración, aquí noto más resistencia.

- Refactor de código: el salto no es solo “sabe más”, es que se acuerda de la intención que marcaste al inicio del refactor y no reintroduce deuda que ya descartaste.

- Contenido + datos: para informes con tablas y visuales, la multimodalidad reduce el baile de formatos.

- Búsqueda aplicada: cuando AI Mode está disponible, se convierte en una ventaja táctica (resúmenes y acciones inmediatas), pero conviene validarlo con fuentes.

Mi regla: usa Gemini 3 para proyectos de varias etapas, y combina con otras IAs cuando necesites especialización concreta (por ejemplo, estilos creativos muy específicos o integraciones que aún no estén maduras en tu stack).

Guía rápida para empezar: 7 pruebas en 15 minutos

- Mapa de un proyecto: “Léete este repo / carpeta y dame un diagrama de módulos, riesgos y quick wins.”

- Resumen con verificación: “Resume estas 5 fuentes, crea un checklist y añade 3 contraejemplos.”

- Plan de 6 semanas: backlog + hitos + métricas de éxito + alertas.

- Agente de QA: genera tests de humo y de regresión para una ruta crítica.

- Búsqueda aplicada (si tienes AI Mode): “Compara proveedores A/B/C con criterios, dame tabla, fuentes y recomendación.”

- Antigravity: abre un issue, pide a la IA un PR mínimo viable con tests, revisa y mergea con comentarios.

- Estilo de marca: entrena con 3–4 piezas propias y pide variaciones controladas (tono, extensión, CTA).

Seguridad y límites: qué promete Google y qué vigilar

La seguridad en modelos frontera mejora, pero tu higiene operativa sigue siendo clave:

- Datos sensibles: minimiza exposición y usa entornos empresariales para PII.

- Alucinaciones útiles: pide siempre razonamiento paso a paso y criterios de evaluación para reducir errores silenciosos.

- Trazabilidad: guarda prompts y respuestas relevantes; te servirán para auditar decisiones y entrenar mejores instrucciones.

Mi sensación general se parece a la tuya: potencia ilusionante, poder intimidante. La respuesta no es bloquearse, sino adoptar con cabeza: pilotos acotados, métricas claras y planes de salida.

Potencia sin fricción, con cabeza

Con Gemini 3, Google deja de tratar su IA como “un producto más” y la convierte en motor silencioso de casi todo. En mi día a día, eso se traduce en menos fricción, más continuidad y la capacidad real de gestionar proyectos largos con ayuda de un agente que no se pierde por el camino. Me entusiasma ese futuro, aunque me obliga a construir defensas: portabilidad, verificación y diversidad de fuentes. Vivimos en modo sprint; la clave es aprender más rápido que la propia herramienta.

FAQs

¿Cómo empiezo si nunca he usado nada de esto?

Crea un espacio de trabajo con tus guías de estilo y un par de datasets de ejemplo. Define 3 tareas repetitivas y conviértelas en “playbooks” que el agente pueda ejecutar y medir.

¿Se nota sin AI Mode en mi país todavía?

Sí. Puedes trabajar con la app y con herramientas de creación (AI Studio/entorno dev). AI Mode acelera búsquedas, pero el valor central (razonamiento, planificación, multimodal) está disponible en el resto del stack.

¿Sustituye a mi equipo de contenido/desarrollo?

No. Aumenta el alcance y la consistencia. El salto grande aparece cuando defines estándares (estilo, calidad, tests) y haces que la IA los cumpla sistemáticamente.

¿Cómo evito quedarme encerrado en una sola plataforma?

Estandariza prompts, guarda datasets en formatos abiertos, y mantén versiones espejo de tus flujos críticos en otra herramienta. Así reduces riesgo y mantienes negociación real.

Opinión Personal

Siento que con Gemini 3 Google dejó de “participar” en la carrera de la IA para decir: quiero liderarla. No llega como una demo brillante, llega como una capa que se pega a todo: Búsqueda, la app, AI Studio, Vertex y hasta un nuevo entorno para programar. Eso cambia la conversación: ya no es “preguntar a una IA”, es trabajar con un agente que no se pierde en la tercera iteración.

La integración en la Búsqueda es lo más emocionante… y lo más delicado. Ahorra tiempo, sí; resume, compara y propone planes. Pero también impone un filtro inteligente que decide qué vemos y cómo lo vemos. Ganamos velocidad; perdemos parte del control si no aprendemos a cuestionar el encuadre. Para mí, la fórmula es simple: usar AI Mode para acelerar y validar con fuentes para no caer en atajos cómodos.

Antigravity me parece la jugada más ambiciosa. No es un copiloto que te sugiere líneas: es un flujo completo (idea → código → pruebas → entrega) con memoria y objetivos. ¿Sustituye a un dev? No. Pero multiplica lo que un equipo pequeño puede abarcar en una tarde. Si esto se consolida, veremos menos tiempo en “papeleos de infraestructura” y más en criterio y calidad.

¿Y el ritmo? Vivimos en modo sprint. Ilusiona por la potencia y asusta por la concentración de poder. Mi conclusión: adopción con cabeza, pilotos acotados, portabilidad de datos y métricas claras. La IA ya no es un producto, es el motor silencioso del ecosistema.

Ahora te toca: ¿qué te entusiasma y qué te inquieta de Gemini 3? ¿Cómo te ha cambiado el día a día? Déjame tus comentarios y lo debatimos.